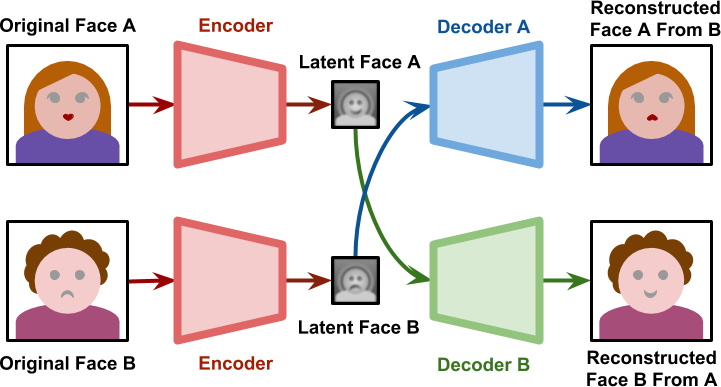

Le implicazioni, gli usi, gli ambiti e le potenzialità dell’intelligenza artificiale sono sconfinati e di natura completamente diversa gli uni dagli altri e chi è un assiduo lettore di questo blog avrà notato come l’IA abbia una presenza rilevante al suo interno. Vediamo ora un’ulteriore sfaccettatura di questa tecnologia che riguarda una sfera più mediatica e di largo impatto; se negli ultimi anni si è parlato molto di fake news, e cioè di notizie deliberatamente false, scritte e diffuse allo scopo di creare disinformazione, presto si parlerà del loro salto di qualità, un tipo di distorsione della realtà nella quale sarà più facile cadere e che sarà più difficile da smentire attraverso un classico lavoro di inchiesta giornalistica e un’accurata ricerca delle fonti: i deepfake. In estrema sintesi, essi sono immagini o più facilmente video, in cui una persona qualsiasi pensa di stare osservando un personaggio dire o fare delle cose, eppure non è vero niente. I primi esempi di deepfake risalgono al 2017 quando questo tipo di tecnologia venne impiegato, in ambito pornografico, per diffondere finti video con protagonisti personaggi famosi. Questi erano video in cui al volto di un’attrice o di un attore porno veniva sostituito quello di un attore cinematografico di Hollywood, attraverso una tecnica chiamata “generative adversarial networks” o GAN. Ma vediamo più nello specifico come questo sia possibile; per spiegare i deepfake la cosa cui rifarsi, forse non più semplice ma di sicuro più esplicativa, è il concetto di autoencoder, un sistema di intelligenza artificiale costruito su più strati neurali che riesce a decodificare e codificare un input o segnale. L’autoencoder, partendo da un’immagine, un simbolo o una sequenza costruisce una rappresentazione, una maschera, che interpreta come facente riferimento al contenuto di partenza. Questo processo può essere utilizzato, per esempio, nel caso di contenuti o simboli rovinati o deteriorati: l’autoencoder sarà infatti in grado di riprodurre la parte rovinata, ricostruendo la parte mancante e quindi migliorandone la resa. Se prendiamo l’esempio specifico di un volto umano, l’autoencoder, partendo dal volto originale, creerà una cosiddetta latent face, o vettore di base, per poi restituirla, tramite un decoder, ricostruita o migliorata. Ecco, nel concetto di deepfake, il tutto acquista però un significato diverso. In questo caso infatti encoder e decoder vengono scissi, disaccoppiati; da un lato avremo quindi un encoder che dal volto A trova il latent face A, ma su cui viene applicato un altro decoder, quello di B, andando quindi a ricostruire la parte di viso di A su B. Per avere una visione più comprensibile di questi passaggi ci rifacciamo all’immagine 1:

Come si può facilmente immaginare questo apre le porte dell’immaginazione e i casi di applicazione sono infiniti. Ma quale impatto può avere sulla società che ci circonda un uso della tecnologia di questo tipo e con queste potenzialità? In una narrativa in cui un soggetto viene convinto visualmente che qualcosa stia accadendo anche se così non è, quali precauzioni o soluzioni possono essere adottate?

Da quando i deepfake sono comparsi su internet i ricercatori hanno immediatamente iniziato a studiare dei metodi per smascherare i video falsi. Uno di questi era basato sull’identificazione e riconoscimento di piccoli gesti, cenni impercettibili del corpo, come ad esempio la frequenza con cui vengono sbattute le palpebre. Ma sfortunatamente anche l’ultima generazione di deepfake si è subito adattata a questo meccanismo obbligando la ricerca a trovare nuove soluzioni. Altri metodi per smascherare i deepfake sono l’analisi e l’osservazione, tramite un algoritmo, dei pixel in alcuni specifici fotogrammi. Un altro uso dei pixel, questa volta a scopo precauzionale, prevede l’inserimento di alcuni di questi nello sfondo di un’immagine come disturbo in modo da impedirne future manipolazioni.

Quello purtroppo che è certo ancora ad oggi è che i “fakers” sono sempre all’avanguardia e che al momento non esistono delle vere e proprie soluzioni ma più che altro una continua corsa ai ripari.

Commenti recenti